Übersicht

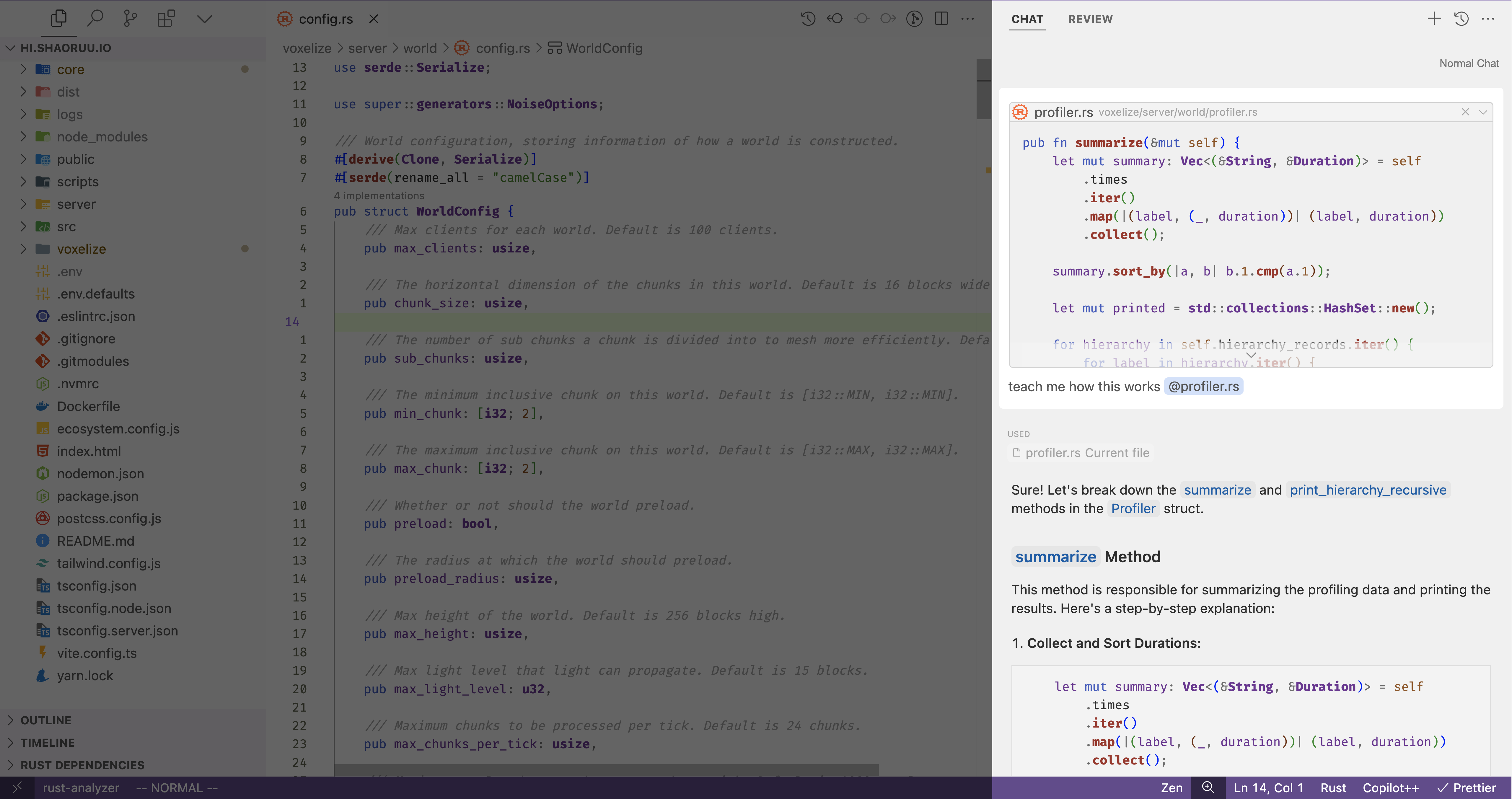

Der Cursor Chat ermöglicht es Ihnen, die leistungsstärksten Sprachmodelle zu nutzen, um Fragen zu Ihrer Codebase zu stellen und Probleme zu lösen. Alles geschieht direkt im Editor.

Damit Sprachmodelle gute Antworten liefern können, benötigen sie spezifische Informationen (Kontext) über Ihre Codebase.

Cursor verfügt über integrierte Funktionen für die Bereitstellung von Kontext im Chat, einschließlich der automatischen Einbindung des gesamten Codebase-Kontexts, Websuche, Dokumentenindexierung und benutzerdefinierte Code-Block-Referenzen. Diese sind darauf ausgelegt, das mühsame Kopieren und Einfügen zu eliminieren, das sonst für die Arbeit von Sprachmodellen mit Code erforderlich wäre.

Standardmäßig befindet sich der Cursor Chat im KI-Bereich, der sich auf der gegenüberliegenden Seite der primären Seitenleiste befindet. Sie können den KI-Bereich mit Strg/⌘ + L ein- und ausblenden, und wenn er geöffnet ist, wird der Chat fokussiert.

Drücken Sie Enter, um Ihre Anfrage abzusenden.

Benutzer- und KI-Nachrichten

Benutzernachrichten enthalten den von Ihnen eingegebenen Text und den referenzierten Kontext. Sie können zu vorherigen Benutzernachrichten zurückkehren, um die Anfrage zu bearbeiten und erneut auszuführen. Dies überschreibt alle nachfolgenden Nachrichten und generiert neue.

KI-Nachrichten sind Antworten, die von Ihrem gewählten KI-Modell generiert werden. Sie sind mit vorhergehenden Benutzernachrichten gepaart. KI-Nachrichten können geparste Code-Blöcke enthalten, die mit Sofort anwenden zu Ihrer Codebase hinzugefügt werden können.

Alle Benutzer-/KI-Nachrichten im selben Thread zusammen werden als Chat-Thread bezeichnet, und jeder Chat-Thread wird im Chat-Verlauf gespeichert.

Chat-Verlauf

Sie können den Chat-Verlauf anzeigen, indem Sie auf die Schaltfläche "Vorherige Diskussionen" oben rechts im KI-Bereich klicken oder Strg/⌘ + Alt/Option + L drücken. Sie können auf jeden Chat-Thread klicken, um zurückzugehen und die Nachrichten anzuzeigen, aus denen er besteht,

und Sie können auf das Stift-Symbol klicken, um Thread-Titel zu bearbeiten, oder über Threads im Verlauf hovern und auf das Papierkorb-Symbol klicken, um sie zu löschen.

Cursor Thread-Titel sind die ersten Wörter der ersten Benutzernachricht.

Standard-Kontext

Standardmäßig enthält der Cursor Chat die aktuelle Datei als Kontext. Sie können eine Anfrage ohne Kontext senden, indem Sie beim Absenden Alt/Option Enter drücken.

Oder Sie können Kein Kontext als Standard unter Cursor-Einstellungen > Funktionen > Chat aktivieren. Chats, die mit einer kontextlosen Anfrage beginnen, fügen den Nachrichten keinen Kontext hinzu.

Sie können sehen, was im Kontext enthalten sein wird, in den Kapseln unter dem Eingabefeld während Sie tippen.

Kontext hinzufügen

Standardmäßig enthalten Benutzernachrichten den von Ihnen eingegebenen Text und den referenzierten Kontext. Sie können jedem Bubble mit @ Symbolen benutzerdefinierten Kontext hinzufügen, und standardmäßig wird die Datei, die Sie gerade ansehen, auch als Kontext in Benutzernachrichten verwendet.

Weitere Details finden Sie auf der Seite @ Symbole.

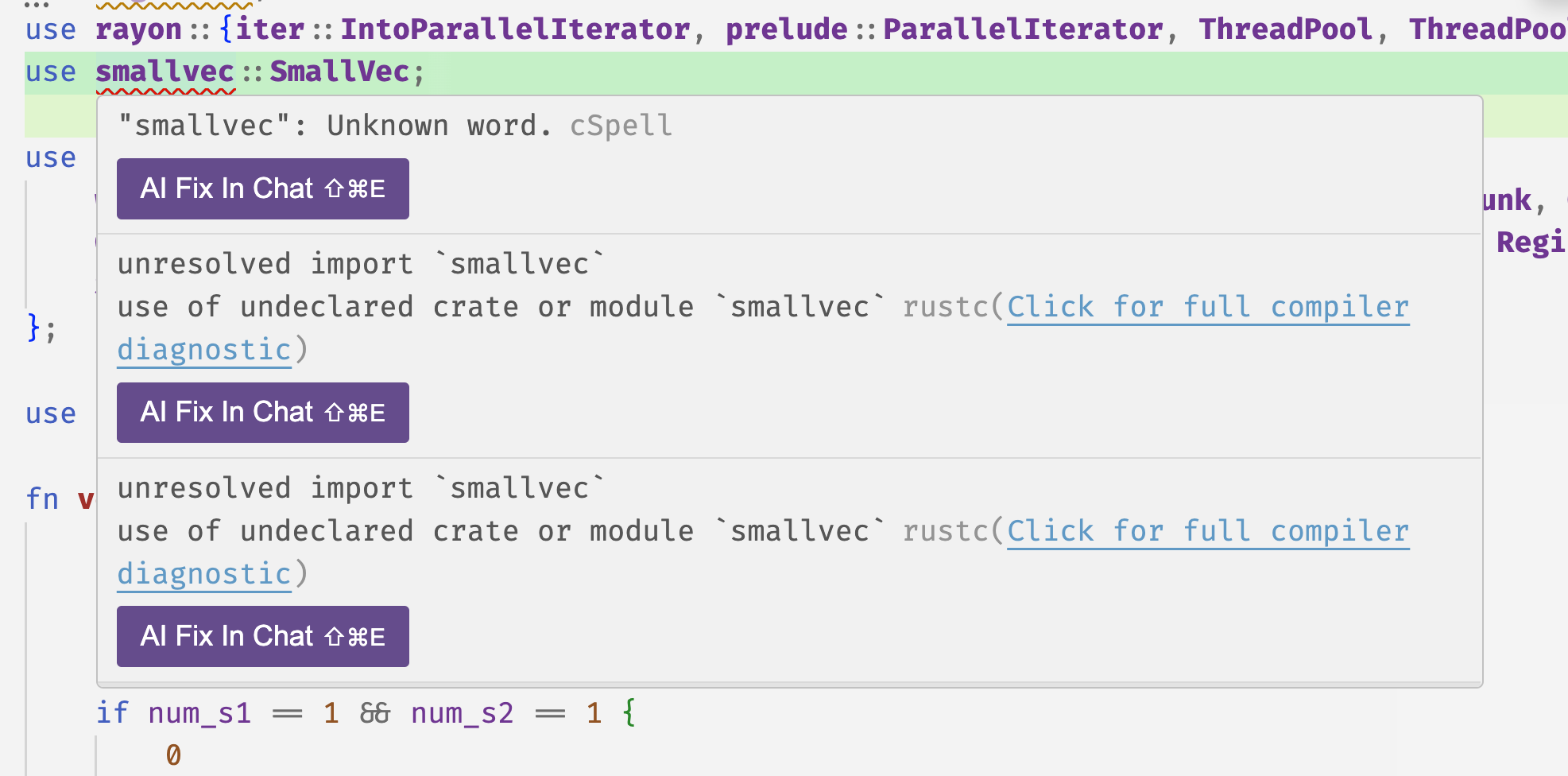

KI-Korrekturen im Chat

Eine praktische Funktion zur Behebung von Linter-Fehlern in Ihrer Codebase ist die Verwendung von KI-Korrekturen im Chat. Hovern Sie dazu über einen Fehler in Ihrem Editor und klicken Sie auf die blaue KI-Korrektur-Schaltfläche, die erscheint.

Die Tastenkombination dafür ist Strg/⌘ + Umschalt + E.

Langkontext-Chat

Sie können den Langkontext-Chat unter Cursor-Einstellungen > Beta > Langkontext-Chat aktivieren. Wenn aktiviert, können Sie mit Strg/⌘ . zwischen verschiedenen Chat-Modi wechseln.

Im Langkontext-Chat können Sie ganze Ordner als Kontext einbinden, da unterstützte Modelle große Kontextfenster haben. Siehe hier für Modelle, die nur für lange Kontexte geeignet sind.

Langkontext-Modelle

Einige KI-Modelle sind speziell für die Verarbeitung langer Kontexte ausgelegt. Diese Modelle können viel größere Textmengen auf einmal verarbeiten, was sie ideal für Aufgaben macht, die das Verständnis umfangreicher Codebases oder Dokumentationen erfordern.

Verfügbare Modelle

- GPT-4 32k: OpenAIs GPT-4-Modell mit einem 32k-Token-Kontextfenster

- Claude 100k: Anthropics Claude-Modell mit einem 100k-Token-Kontextfenster

Anwendungsfälle

Langkontext-Modelle sind besonders nützlich für:

- Analyse ganzer Codebases

- Verständnis komplexer Dokumentation

- Verarbeitung mehrerer Dateien gleichzeitig

- Bearbeitung großer Code-Refactoring-Aufgaben